(通讯员:谢东霖 李姗姗)2024年12月13日,由中国中文信息学会(CIPS)青年工作委员会主办、湖南师范大学承办的“CIPS青年工作委员会走进高校”系列活动在中和楼338会议室成功举行。活动当天,多位自然语言处理、大模型领域的专家出席会议,不仅分享了最新的研究成果和行业动态,还与学生们进行了深入交流。

出席嘉宾包括中科院自动化研究所刘康研究员,华南理工大学蔡毅教授,浙江大学张宁豫特聘研究员,苏州大学李俊涛青年特聘教授,中国中文信息学会青年工作委员会副主任、中科院自动化研究所陈玉博副研究员,中国中文信息学会青年工作委员会秘书长、中南大学覃立波特聘教授,以及湖南师范大学信息科学与工程学院李常枫书记,副院长肖林教授,人工智能系曾道建副教授。活动由肖林教授和曾道建副教授共同主持。

会议伊始,李常枫书记热烈欢迎专家们的到来,并对他们的支持表示衷心感谢。李书记强调,本次活动不仅为学术交流提供了平台,更为我校相关专业的建设和发展提供了宝贵经验。随后,陈玉博副主任介绍了CIPS青年工作委员会的相关情况,并分享了CIPS青工委组织的系列活动。

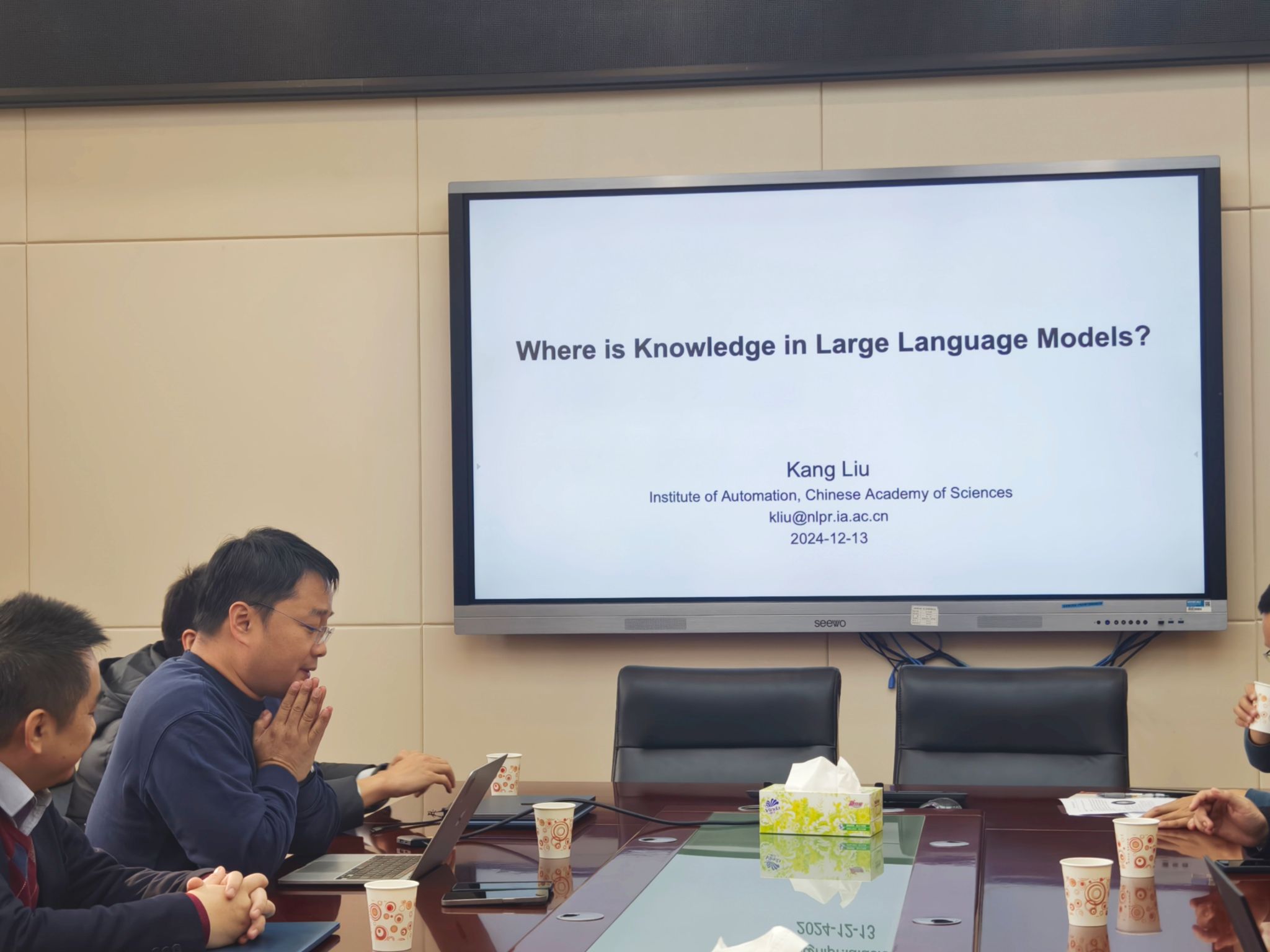

在学术报告环节,四位专家分别围绕大模型技术的最新研究成果进行了深入讲解。刘康老师以“Where is Knowledge in Large Language Models?”为题,探讨了知识在大语言模型中的存储与理解问题;蔡毅老师带来了题为“基于多模态数据的知识图谱构建技术”的报告,重点讲解了多模态数据在知识图谱构建中的应用,并提出了创新的多模态实体-关系提取模型;张宁豫老师介绍了“基于大模型的知识发现引擎”,聚焦于非结构化文档的知识抽取,并提出了基于大模型的新型知识发现方法;李俊涛老师的报告“面向大模型的高效推理技术”则探讨了如何在大模型服务中优化算力资源,以提高推理效率。

本次活动吸引了2023级和2024级本科生、研究生及相关教师积极参与,活动不仅深化了大家对大语言模型技术的理解,还为学术研究和技术创新注入了新的动力。

在第一场学术报告中,刘康老师为大家带来了关于大语言模型(LLMs)中知识存储与分析的前沿研究。他深入探讨了LLMs如何从海量数据中汲取知识,以及这些隐性知识与知识图谱中的符号知识之间的关联。阐释了知识定位在LLMs中的重要性,为理解LLMs中的知识结构提供了新的视角。这场报告不仅为我们揭示了LLMs的内在工作机制,也为未来的研究指明了方向。

第二场报告中,蔡毅老师讨论了命名实体识别(NER)和关系抽取(RE)在知识图谱构建中的核心作用,并指出短文本和多模态为这些任务带来了额外的挑战。介绍了多模态命名实体识别(MNER)和多模态关系抽取(MRE)模型,这些模型通过整合视觉信息来增强文本数据,从而提升识别和抽取的准确性。此外,他介绍了多模态实体-关系联合抽取(JMERE)任务,并展示了两种多模态联合抽取模型,这些模型通过图对齐和知识增强技术,有效解决了图像与文本特征不一致和背景信息缺失的问题。蔡老师的报告为我们提供了多模态数据处理在知识图谱构建中的新视角,并对这一领域的未来研究提供了宝贵的经验。

第三场报告中,张宁豫老师指出,基于非结构化文档的知识构建是知识图谱大规模落地的关键难题,尤其在真实世界信息高度碎片化和非结构化的背景下,大语言模型在处理信息抽取时常面临效果不佳的问题。报告介绍了基于大模型的知识抽取范式及OneKE知识抽取引擎,提出根据业务需求灵活选择大小模型进行知识抽取。对于领域固定的Schema,使用专用小模型能高效完成任务,而对于泛化要求较高的Schema,则需训练专用的大模型。分析了当前OneKE引擎的局限性,包括长文本处理、开放抽取与幻觉问题以及低资源部署等挑战。他建议,通过大小模型的协同工作,实现按需高效的知识抽取,促进该领域的进一步发展。

在第四场报告中,李俊涛老师围绕“大模型服务中的算力资源效用优化”展开了详细介绍。随着大模型进入大规模应用服务的关键阶段,如何在有限的算力资源和成本条件下,满足实际应用部署中的服务需求,成为了亟需解决的重大问题。报告从多个角度深入探讨了这一问题,包括自适应的参数剪枝、中间计算结果压缩以及高效解码算法等技术手段,系统分析了如何通过优化算力资源的使用,提升大模型服务的效能。

每场报告结束后,同学们积极提问,与专家们展开了深入而热烈的交流。老师们耐心细致地解答疑惑,分享了宝贵的学术经验和独到见解,激发了同学们的思考与探索热情。这些深度互动不仅帮助同学们更全面地理解大模型技术,也开阔了他们的学术视野。本次活动为师生提供了宝贵的交流机会,促进了思想的碰撞与融合,对学术合作与创新起到了积极的推动作用,意义深远。

编辑:谢东霖 李姗姗

一审:崔玉茹

二审:曾道建

三审:肖林

地址:湖南省长沙市岳麓区岳麓山

地址:湖南省长沙市岳麓区岳麓山 邮箱:411621481@qq.com

邮箱:411621481@qq.com 电话:0731-88872628

电话:0731-88872628 邮编:410001

邮编:410001